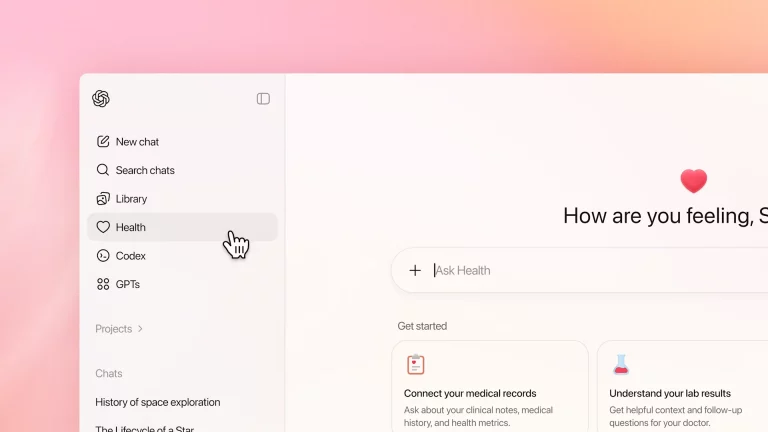

Las plataformas de inteligencia artificial están entrando con fuerza en el sector de la salud. En lo que va del año han comenzado a aparecer nuevos modelos enfocados en salud y bienestar como ChatGPT Salud, Copilot Health y soluciones impulsadas por Amazon. Todos con un mismo objetivo de ayudar a las personas a entender mejor su información médica.

A medida que más usuarios se relacionan con la IA para resolver sus dudas, las plataformas adaptan sus asistentes. Cada vez más usuarios consultan síntomas, resultados o dudas de salud en herramientas de IA, buscando respuestas rápidas y en lenguaje sencillo. De hecho, cuando OpenAI lanzó el modelo de ChatGPT Salud en enero, aseguró que más de 230 millones de personas en todo el mundo hacen preguntas sobre salud y bienestar cada semana.

‘Googlear’ síntomas está quedando en el pasado

A diferencia de las búsquedas tradicionales, estas plataformas no solo muestran enlaces: explican, resumen y organizan la información de forma más clara. Algunas incluso permiten interpretar resultados médicos, centralizar datos de wearables o preparar preguntas antes de una consulta, lo que cambia la relación de los usuarios con la información.

En algunos casos más avanzados, funcionan como una capa intermedia entre el paciente y el sistema de salud, acercando contenidos que antes eran difíciles de entender. Y ahí está su mayor reto: hacer que la información médica sea más accesible a nivel universal.

Aunque los modelos de IA enfocados en salud cuentan con una enorme cantidad de datos, estos modelos no están completamente diseñados para contextos locales o regionales, en este caso para América Latina. “Los profesionales de salud latinoamericanos navegan entre docenas de fuentes dispersas, sin encontrar una solución que hable su idioma y resuelva sus necesidades reales. Queremos que toda la información que el médico necesita en su día a día esté centralizada en un solo lugar”, dice Manuela Gutiérrez, líder de operaciones de 360 Health Data.

Solo el idioma, de hecho, sigue siendo un desafío. Aunque estos sistemas han mejorado en español, la calidad puede variar dependiendo del contexto clínico y la disponibilidad de datos, que sigue siendo mayor en inglés.

El riesgo cuando la IA parece tener siempre la razón

El problema no es la tecnología en sí, sino la forma en que se percibe por parte de los usuarios. Estas herramientas pueden ofrecer respuestas claras, estructuradas y con un tono de seguridad que no siempre refleja la complejidad real de un diagnóstico médico. Esto puede generar una falsa sensación de certeza, especialmente en temas delicados donde una mala interpretación puede tener consecuencias importantes.

A esto se suman otros retos relevantes. Existen preocupaciones sobre posibles errores en la interpretación de síntomas, especialmente cuando la información que introduce el usuario es incompleta o ambigua. También hay dudas sobre la privacidad, ya que estos sistemas trabajan con datos altamente sensibles como historiales médicos, hábitos y otros aspectos personales.

Además, empieza a evidenciarse una creciente dependencia, con usuarios que recurren primero a la IA antes de buscar la orientación de un profesional de la salud.

No cabe duda de que la IA tiene el potencial de convertirse en una gran aliada para millones de personas, especialmente en contextos donde acceder a información médica clara sigue siendo difícil o toma demasiado tiempo. En ese sentido, puede ayudar a reducir barreras, mejorar la comprensión y permitir que los pacientes lleguen mejor preparados a una consulta médica.

Sin embargo, también obliga a ser más críticos como usuarios. No reemplaza a un médico, ni debería hacerlo. Su valor está en acompañar, orientar y facilitar la comprensión, pero siempre dentro de un marco de uso responsable.

Imagen: Chatgpt