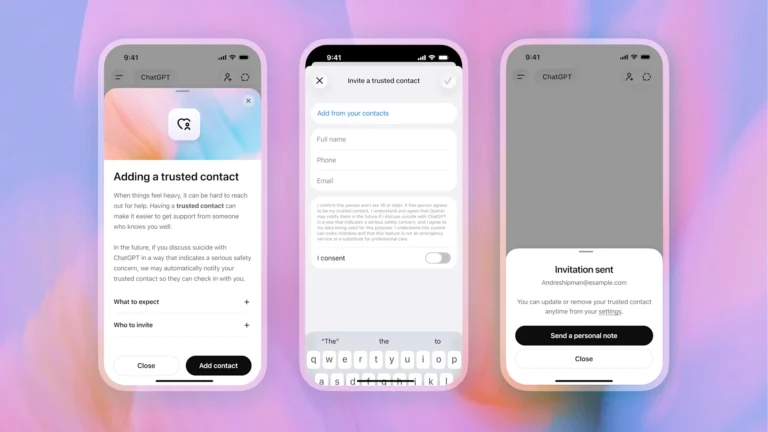

OpenAI comenzó a implementar una nueva función de seguridad en ChatGPT llamada Trusted Contact, o “Contacto de confianza”, que permitirá alertar a una persona cercana cuando el sistema detecte posibles señales de riesgo grave relacionadas con autolesiones o suicidio.

La herramienta está dirigida a usuarios mayores de 18 años y funciona de manera opcional. Si decides activarla, podrás registrar a un amigo, familiar o cuidador para que reciba una notificación en caso de que ChatGPT identifique conversaciones que indiquen una posible crisis emocional.

La medida amplía un sistema que ya existía para cuentas de adolescentes bajo controles parentales. Ahora cualquier adulto podrá añadir un contacto de confianza desde la configuración de la plataforma.

Según OpenAI, el objetivo no es reemplazar la atención psicológica ni los servicios de emergencia. La función actúa como un puente para ayudar a que las personas puedan conectarse con alguien cercano cuando atraviesan un momento delicado.

¿Cómo funciona el nuevo Contacto de confianza?

El proceso comienza cuando el usuario agrega a otra persona dentro de la configuración de ChatGPT. Ese contacto debe aceptar una invitación en un plazo máximo de siete días para que la herramienta quede activa.

Si posteriormente los sistemas automatizados de OpenAI detectan conversaciones relacionadas con autolesiones que representen una preocupación seria, ChatGPT primero le informará al usuario que podría notificarse a su contacto registrado.

Después entra una revisión humana. Un pequeño grupo de especialistas capacitados analiza el caso y decide si la situación requiere enviar la alerta.

Te puede interesar: Amazon Pet Days 2026: las mejores ofertas en comida, juguetes y tecnología para mascotas

La notificación puede llegar por correo electrónico, mensaje de texto o mediante la aplicación de ChatGPT. OpenAI asegura que no se compartirán transcripciones ni detalles privados de la conversación.

El mensaje únicamente indicará que se detectó una situación potencialmente preocupante y sugerirá que la persona de confianza se comunique con el usuario.

La empresa también explicó que los usuarios podrán cambiar o eliminar ese contacto en cualquier momento desde la configuración de la cuenta.

IA, salud mental y límites de privacidad

La llegada de Trusted Contact vuelve a poner sobre la mesa el papel que está tomando la inteligencia artificial en conversaciones personales y emocionales.

Cada vez más personas usan chatbots para hablar de ansiedad, problemas familiares, estrés o momentos difíciles. Eso ha llevado a empresas como OpenAI a fortalecer mecanismos para detectar posibles riesgos sin invadir completamente la privacidad de los usuarios.

La compañía afirma que el sistema fue desarrollado junto a psicólogos, investigadores y organizaciones especializadas en prevención del suicidio. Entre ellas aparece la Asociación Americana de Psicología.

Además del nuevo sistema de alertas, ChatGPT ya cuenta con otras medidas relacionadas con bienestar digital. Por ejemplo, puede sugerir pausas tras largos periodos de uso, recomendar líneas de ayuda en crisis y bloquear solicitudes que pidan instrucciones para autolesionarse.

OpenAI reconoce que ningún sistema automatizado es perfecto y admite que una alerta no siempre reflejará con precisión el estado real de una persona. Aun así, sostiene que todas las notificaciones pasan por supervisión humana antes de enviarse.

La implementación comenzará de forma gradual y llegará primero a usuarios adultos que quieran activar voluntariamente la función.