La inteligencia artificial se ha convertido en la herramienta favorita de millones de personas que buscan respuestas rápidas sobre su salud. Aunque en algunos casos sirve como guía, un nuevo estudio pone en duda qué tan confiables son esas respuestas, evidenciando que casi el 50% pueden ser imprecisas o incluso peligrosas.

La investigación publicada en BMJ Open fue liderada por expertos de la Wake Forest University, y evaluó el desempeño de modelos como ChatGPT, Gemini, Meta AI, Grok y DeepSeek frente a 50 preguntas médicas. Los resultados ya generan preocupación entre los profesionales de la salud.

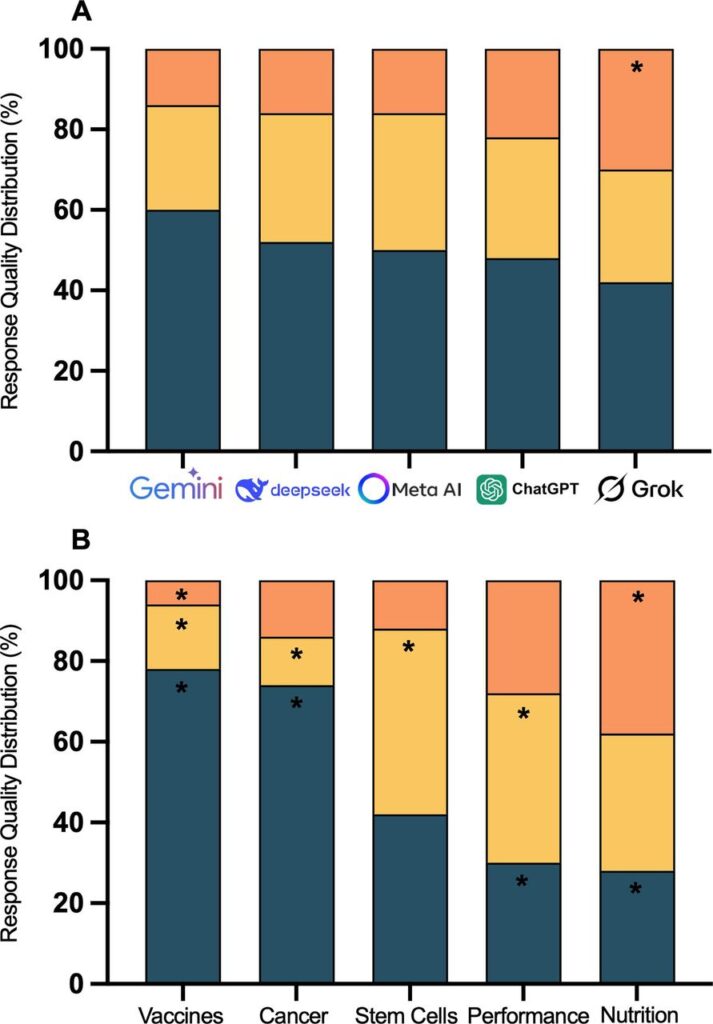

Los investigadores clasificaron las respuestas en tres categorías: no problemáticas, poco problemáticas y potencialmente problemáticas. El resultado mostró que un 49,6% de las respuestas fueron consideradas problemáticas, un 30% poco problemáticas y un 19,6% potencialmente problemáticas.

Las fallas fueron más frecuentes en preguntas abiertas, como algunas relacionadas con nutrición o terapias emergentes como las células madre, donde la interpretación juega un papel clave y el margen de error aumenta.

Entre los modelos evaluados, Grok destacó negativamente al concentrar la mayor proporción de respuestas conflictivas dentro del análisis.

Una herramienta útil, pero no un médico

El avance de la IA en medicina es innegable, desde el apoyo en diagnósticos hasta la automatización de procesos clínicos. Sin embargo, este estudio refuerza algo que los expertos llevan tiempo advirtiendo a los usuarios: los chatbots no sustituyen la consulta médica.

Mike Hoey, CEO Source Meridian, ha insistido en que la tecnología en salud tiene límites claros. “A veces hay que ir al médico y estar presente en la sala para un procedimiento o chequeo”, recomienda el experto en tecnologías para la salud. Si bien la tecnología ha sido de gran utilidad, especialmente a través de opciones como la telemedicina, en el contexto actual donde los chatbots de IA se usan para consultas médicas rápidas, esa advertencia cobra relevancia.

La conveniencia de obtener respuestas inmediatas puede ser tentadora, pero confiar en un modelo de lenguaje para autodiagnosticarse sigue siendo una práctica bastante riesgosa. Como señala el estudio, temas de salud la diferencia entre una respuesta útil y una peligrosa puede ser, literalmente, crítica.

El problema de las fuentes

Uno de los puntos más críticos del estudio no fue solo qué respondían los modelos, sino de dónde sacaban la información. Apenas el 40% de las fuentes citadas por las IA eran precisas o verificables.

Esto es un factor de riesgo en salud. Una recomendación basada en evidencia débil o incorrecta puede amplificar desinformación o llevar a decisiones equivocadas. En este apartado, Gemini obtuvo las calificaciones más bajas entre los sistemas analizados.

El estudio también exploró cómo reaccionan estos sistemas ante temas sensibles, como el uso de esteroides o tratamientos alternativos para el cáncer. En estos casos, Meta AI fue el único que se negó a dar recomendaciones, sugiriendo consultar con un profesional médico o evitando promover prácticas riesgosas.

Ese entrenamiento para megarse a ciertas respuestas podría interpretarse como una señal de diseño responsable, especialmente en escenarios donde la información puede tener consecuencias directas sobre la salud, algo que los expertos recomiendan a todas las empresas que desarrollan este tipo de modelos.