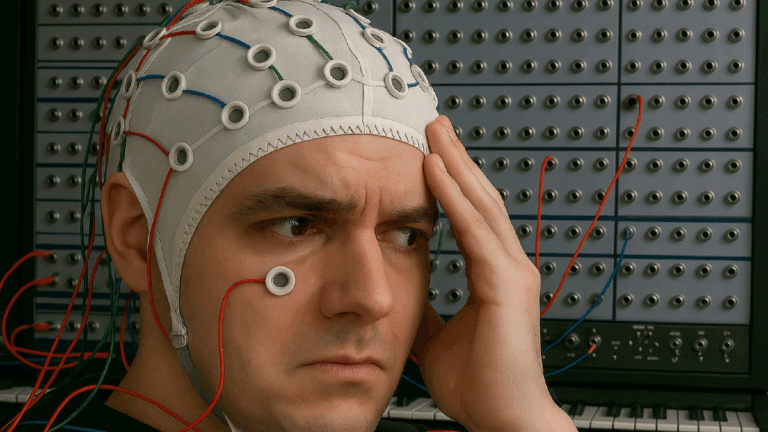

Una inquietante tecnología desarrollada en India —y actualmente usada en decenas de procesos judiciales— ha generado alarma en la comunidad científica internacional. Se trata del sistema BEOS (Brain Electrical Oscillation Signature), una prueba que pretende detectar la culpabilidad de una persona al analizar sus ondas cerebrales.

A pesar de los serios cuestionamientos sobre su validez científica y legal, esta controvertida técnica sigue ganando terreno, y ahora existen planes para exportarla a países de América del Sur, según un reciente reportaje de Science—una de las publicaciones científicas más reconocidas y respetadas a nivel mundial—. Lo que algunos presentan como un avance forense, otros lo califican como una amenaza a los derechos humanos y al debido proceso legal.

¿Qué es BEOS y cómo funciona?

Es un sistema que registra la actividad eléctrica cerebral mientras el individuo escucha afirmaciones relacionadas con un delito. Sus defensores sostienen que el cerebro “reacciona” cuando reconoce un recuerdo experiencial —por ejemplo, si la persona realmente vivió el acto criminal—, lo que supuestamente permite determinar su nivel de implicación.

A diferencia del polígrafo, esta prueba no requiere respuestas verbales. El acusado escucha frases del tipo “yo sostuve el arma”, y un software analiza sus ondas cerebrales en busca de patrones que indiquen reconocimiento emocional. Si su cerebro “responde”, se infiere que estuvo presente en la escena del crimen.

El procedimiento parece sacado de una novela de ciencia ficción, pero ha sido utilizado por agencias judiciales en India en más de 700 casos desde el año 2000, a pesar de la falta de validación independiente o de respaldo en revistas científicas de alto impacto.

Te puede interesar: Cinco habilidades humanas que la inteligencia artificial no puede imitar

Cuestionamientos éticos y científicos

Los principales reparos sobre su uso provienen de la comunidad científica internacional. El sistema no ha superado pruebas rigurosas de replicabilidad, carece de fundamentos neurológicos sólidos y su aplicación no cuenta con protocolos estandarizados.

“Es casi orwelliano”, han señalado críticos como el neuroeticista Henry Greely, de la Universidad de Stanford, en declaraciones al New York Times. Greely subraya que “el deseo de una solución mágica para saber si alguien miente es comprensible, pero muy peligroso si no se sustenta en ciencia sólida”.

Además, el uso de BEOS sin consentimiento informado, en contextos de detención prolongada o bajo coacción, plantea serias dudas sobre derechos humanos. La Corte Suprema de India ya advirtió en 2010 que no se puede forzar a una persona a someterse a este tipo de pruebas sin su autorización voluntaria.

El interés de Sudamérica y el riesgo de su adopción

Lo más preocupante para muchos especialistas es que, a pesar de estos cuestionamientos, la técnica está siendo promovida activamente fuera de India. Según Science, delegaciones forenses indias han ofrecido conferencias sobre su funcionamiento a funcionarios de varios países de Sudamérica y África. En algunos casos, ya se han iniciado negociaciones para la compra de equipos relacionados.

La empresa Axxonet, que tiene los derechos exclusivos sobre esta tecnología, lidera la expansión internacional del sistema. La concentración del control en una sola compañía ha generado inquietudes sobre conflictos de interés y falta de transparencia.

Expertos en derecho penal y neurociencia advierten que la adopción acrítica de BEOS por parte de países con sistemas judiciales frágiles o sobrecargados podría tener consecuencias devastadoras, como condenas basadas en pruebas pseudocientíficas, retrocesos en las garantías del debido proceso y un riesgo enorme de errores judiciales.

La ilusión tecnológica y sus consecuencias

El avance de tecnologías como esta, plantea una pregunta urgente sobre si debemos confiar en herramientas que prometen “leer la mente” cuando no existe consenso científico sobre su eficacia. La tentación de contar con una prueba que simplifique las investigaciones criminales es grande, pero los riesgos superan los beneficios cuando los derechos fundamentales están en juego.

En palabras del propio Henry Greely: “Tal vez algún día tengamos una forma precisa de detectar mentiras, pero ese día no ha llegado. Hasta entonces, debemos proteger la dignidad humana y no arruinar vidas con herramientas que no entendemos completamente”.

Organizaciones de derechos humanos, junto con académicos y juristas, observan con creciente preocupación el avance de BEOS, especialmente ante la posibilidad —cada vez más cercana— de que esta controvertida tecnología llegue a Sudamérica.

Imagen: Editada conb IA / ChatGPT